Non è colpa dell’AI

Redazione I Martedì

Ultimi post di Redazione I Martedì (vedi tutti)

- Passeggiate sotto i portici - Agosto 2, 2024

- Le voci dei giovani - Maggio 31, 2024

- CHIMAR: IMBALLAGGIO INDUSTRIALE - Aprile 5, 2024

L’etica riguarda la libertà e la responsabilità dell’agire umano. Ora, il progresso della tecnica, che di per sé è destinata a migliorare le condizioni e le prestazioni della vita umana, non solo ha permesso con le sue macchine di liberarci dalla fatica sostituendosi ad essa, ma ha raggiunto oggi con l’intelligenza artificiale (AI) un tale grado di sviluppo, di progresso e di perfezione, da imitare e sostituire le nostre stesse capacità conoscitive (computer), il nostro comportamento, e perfino le nostre decisioni. Questo, da una parte, apre alla scienza e alla tecnologia campi di applicazioni sconfinati e illimitati, ma solleva alcuni gravi e delicati problemi etici: fino a che punto possiamo usare l’intelligenza artificiale come strumento per liberarci dai condizionamenti della natura, e fino a che punto, invece, siamo da essa condizionati nelle nostre scelte e nella nostra libertà? Pensiamo, per esempio, ad un caso concreto: nelle nostre automobili abbiamo a disposizione i navigatori, che ci indicano la strada da seguire per arrivare alle mete da noi desiderate. Siamo noi, però, a decidere dove vogliamo andare e siamo liberi di seguire o meno le indicazioni stradali che ci vengono offerte. Ma domani, quando la tecnologia avrà raggiunto la capacità di offrire alle macchine la guida automatica e i navigatori potranno loro stessi prendere i comandi della guida, fino a che punto saremo liberi e responsabili nell’uso delle nostre vetture? Inoltre, come possiamo distinguere il linguaggio e le espressioni che sono frutto dell’intelligenza umana da

quelli che sono prodotti dall’intelligenza artificiale?

Ma ciò su cui più ci interroghiamo è la seguente questione: in un prossimo futuro è possibile prevedere la realizzazione di robot autocoscienti e di conseguenza liberi e responsabili?

Consideriamo intanto due settori dell’eticità che possono impattare con l’AI: la nostra responsabilità etica, infatti, ha a che fare soprattutto e principalmente con due valori: quello della verità e quello della libertà. Siamo infatti chiamati a rispondere di quello che pensiamo e diciamo, se corrisponde o meno al vero, ma siamo anche responsabili della verità di quello che facciamo dire all’AI? La disciplina scientifica oggi dominante è la statistica, che ci permette di monitorare la realtà e di prevedere il futuro, ed è sempre più dipendente dall’AI. Ma fino a che punto il sapere che l’80% di una popolazione ritiene che una informazione sia vera, ci garantisce che essa corrisponda effettivamente alla realtà? Le statistiche ci fanno vivere nel mondo delle opinioni, non delle verità incontrovertibili.

Ma la ricerca della verità non si accontenta di una semplice probabilità statistica.

Inoltre, oggi è scientifico, ovverosia vero, ciò che è riproducibile sperimentalmente dall’uomo; e in questo l’AI permette di simulare la realtà con modelli sempre più perfezionati. Ma i perfezionamenti dell’AI giungono al punto da rendere sempre più “indecidibile” distinguere il linguaggio artificiale da quello naturale, e riconoscere se un comunicato ha come soggetto un essere umano o una macchina.

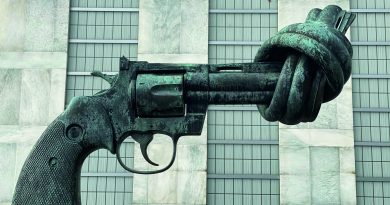

E per quanto riguarda la libertà, è vero che la tecnologia e l’AI ci hanno reso sempre più liberi nelle nostre scelte e ci offrono una vastità e varietà sempre maggiore di possibilità operative, ma il loro potere non è illimitato ed esse non sono direttamente responsabili dell’uso che ne facciamo e delle scelte che, attraverso di loro, possiamo compiere. Diceva Francesco Bacone, il quale è all’origine della nascita della scienza moderna: «Per dominare la natura dobbiamo obbedirle». E in effetti, se con la tecnologia possiamo superare i limiti della natura, dobbiamo prima conoscerne le leggi, imitare il suo funzionamento, riprodurre e accrescere le sue potenzialità, e agire in armonia con essa. Altrimenti, come possiamo oggi ben constatare, corriamo il rischio di distruggerla e di distruggere con lei anche noi stessi

Si dice che: «l’intelligenza artificiale non è né buona né cattiva, ma non è neutrale». E in effetti, ciò che rende buona o cattiva questa grande risorsa che abbiamo a disposizione è l’uso che ne facciamo. L’AI non ha altro scopo che quello di migliorare e moltiplicare le proprie prestazioni, simulando sempre più da vicino i comportamenti umani e sostituendosi ad essi; ma chiediamoci: dobbiamo concedere ad essa la libertà di decidere autonomamente che cosa fare delle capacità che noi le abbiamo conferito? Possiamo dotare i robot di quel libero arbitrio che noi abbiamo ricevuto da Dio? Sembra che per adesso questo non sia possibile (e per molti che questo non sarà mai possibile), ma se lo fosse o se questo potesse esserlo in un futuro più o meno vicino, dobbiamo chiederci se sia opportuno che un robot venga dotato di autocoscienza e di capacità di decidere autonomamente che cosa fare o non fare, e in conseguenza di distinguere il bene dal male. Dovremmo decidere se attribuire al robot quel libero arbitrio che l’uomo ha ricevuto da Dio, quando lo ha creato a sua immagine e somiglianza. Dovremmo pensarci bene, visto il cattivo uso della libertà che ne abbiamo fatto e che ne stiamo facendo nella nostra vita e nella storia.